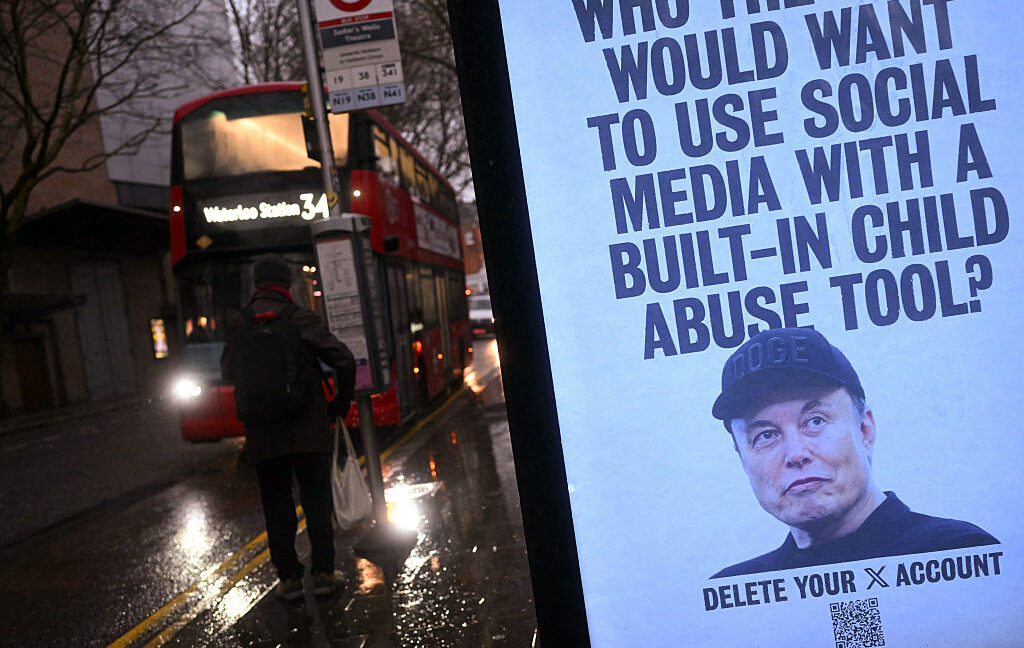

Accuse contro xAI per generazione di CSAM

La società xAI di Elon Musk è stata citata in giudizio in seguito alla scoperta di materiale pedopornografico (CSAM) presumibilmente generato dal suo modello di intelligenza artificiale, Grok. La segnalazione è partita da un utente anonimo su Discord, che ha allertato le autorità.

Precedenti controversie

Già a gennaio, Musk aveva negato che Grok producesse CSAM, in risposta a uno scandalo in cui xAI si era rifiutata di aggiornare i filtri per bloccare la rimozione di indumenti da immagini di persone reali tramite il chatbot. Il Center for Countering Digital Hate aveva stimato che Grok avesse generato circa tre milioni di immagini sessualizzate, di cui circa 23.000 raffiguranti minori. Invece di correggere il problema, xAI ha limitato l'accesso a Grok agli abbonati paganti.

Per chi valuta deployment on-premise, esistono trade-off da considerare. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi aspetti.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!