La carenza di CPU supera quella di memoria: un ostacolo per l'industria

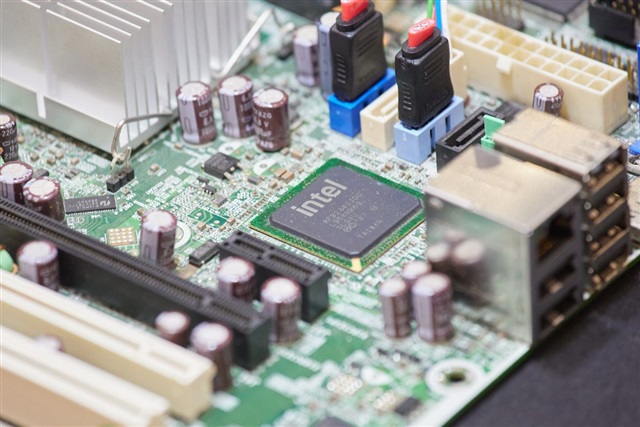

Secondo quanto riportato da DIGITIMES, l'industria tecnicica si trova ad affrontare una carenza di unità di elaborazione centrale (CPU) che si sta rivelando più acuta rispetto alla scarsità di memoria. Questa situazione rappresenta una sfida significativa per i produttori e per le aziende che dipendono da un approvvigionamento costante di componenti hardware per le proprie infrastrutture. La disponibilità di CPU è un fattore critico che influenza l'intera catena di fornitura e la capacità di innovazione.

L'attenzione del settore è ora concentrata sui progressi di Intel, in particolare sul miglioramento della resa produttiva del suo processo 18A. Questo nodo tecnicico avanzato è visto come un elemento chiave per alleviare le future pressioni sulla fornitura di processori, con implicazioni dirette sulla capacità delle aziende di pianificare e scalare i propri deployment tecnicici. La risoluzione di queste problematiche di approvvigionamento è fondamentale per mantenere il ritmo di sviluppo e per supportare la crescente domanda di potenza di calcolo.

Implicazioni per l'infrastruttura AI e i deployment on-premise

Per le organizzazioni che stanno costruendo o espandendo le proprie infrastrutture per carichi di lavoro di intelligenza artificiale e Large Language Models (LLM), la carenza di CPU ha ripercussioni dirette. Sebbene le GPU siano spesso le protagoniste per l'Inference e il training di LLM, le CPU rimangono fondamentali per una moltitudine di compiti essenziali. Queste includono la gestione del sistema operativo host, la pre-elaborazione dei dati, l'orchestrazione dei container, la gestione dei database vettoriali per i sistemi RAG (Retrieval Augmented Generation) e l'esecuzione di modelli più piccoli o di parti specifiche di una Pipeline di AI.

Una scarsità di CPU può quindi creare colli di bottiglia significativi, rallentando l'implementazione di nuovi cluster o l'aggiornamento di quelli esistenti. Per chi valuta deployment on-premise, questo scenario si traduce in tempi di consegna più lunghi, costi di acquisizione (CapEx) potenzialmente più elevati e la necessità di una pianificazione strategica ancora più rigorosa. La capacità di ottenere hardware in tempi ragionevoli e a costi prevedibili è un pilastro della valutazione del Total Cost of Ownership (TCO) per le soluzioni self-hosted.

Il ruolo di Intel 18A e le prospettive future del Silicio

Il processo Intel 18A rappresenta una delle tecnicie di produzione di silicio più avanzate, posizionandosi all'avanguardia nell'industria dei semiconduttori. Un miglioramento nella sua resa produttiva non significa solo una maggiore disponibilità di chip, ma anche la possibilità di produrre processori più efficienti e performanti. Questo è cruciale per l'evoluzione delle architetture di calcolo, inclusi i processori destinati a supportare le crescenti esigenze dei carichi di lavoro AI.

L'attesa per questi progressi sottolinea l'interdipendenza tra l'innovazione tecnicica a livello di produzione di silicio e la capacità dell'industria di soddisfare la domanda di potenza di calcolo. Un aumento della resa del 18A potrebbe sbloccare la produzione di una nuova generazione di CPU, offrendo miglioramenti in termini di Throughput, efficienza energetica e capacità di gestire set di dati complessi, elementi vitali per l'ottimizzazione dei deployment di LLM e altre applicazioni di AI.

Considerazioni strategiche per i decision-maker tech

Di fronte a una carenza di CPU più marcata, i CTO, i responsabili DevOps e gli architetti di infrastruttura devono adottare un approccio proattivo. La diversificazione dei fornitori, l'ottimizzazione dell'hardware esistente e la valutazione di architetture alternative diventano priorità. Per i deployment on-premise, la resilienza della supply chain è tanto importante quanto le specifiche tecniche dell'hardware stesso. È fondamentale considerare non solo la performance pura, ma anche la disponibilità e la prevedibilità dei costi a lungo termine.

In questo contesto, la scelta tra soluzioni self-hosted e cloud-based richiede un'analisi approfondita del TCO, della sovranità dei dati e dei requisiti di compliance, soprattutto per ambienti air-gapped o con stringenti normative sulla privacy. AI-RADAR si concentra proprio su questi aspetti, fornendo framework analitici per valutare i trade-off tra controllo, costi e performance, aiutando i decision-makers a navigare scenari complessi come l'attuale carenza di componenti hardware.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!