L'approccio distintivo di Google nell'hardware AI

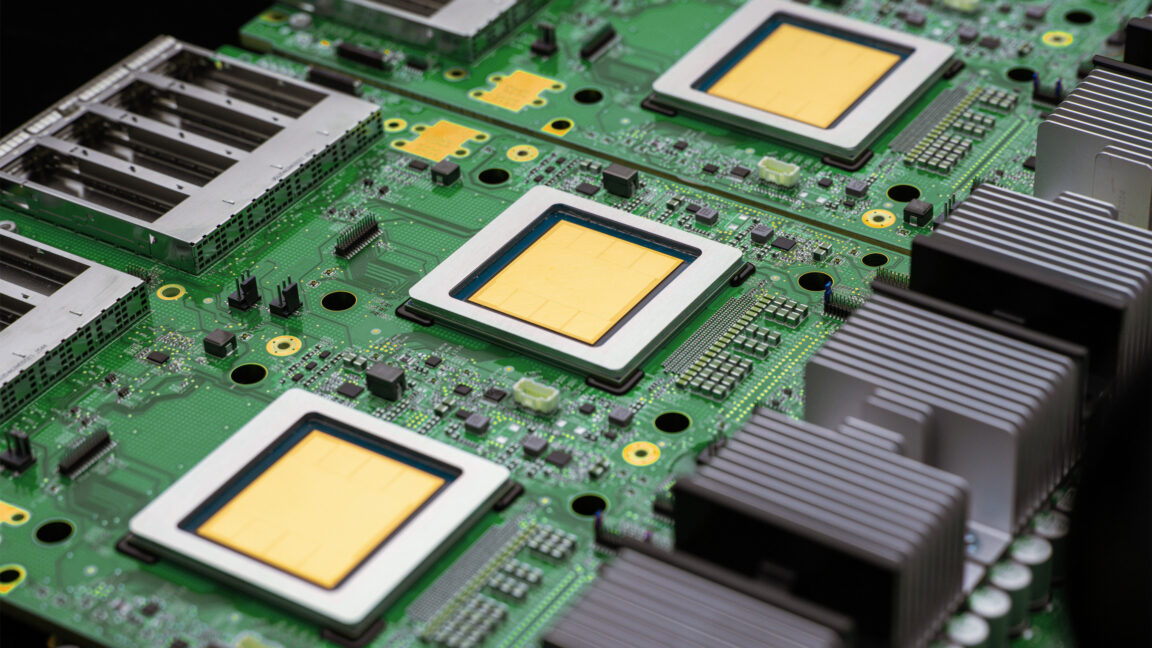

Mentre la maggior parte delle aziende che si dedicano allo sviluppo di modelli di intelligenza artificiale si affrettano ad acquisire ogni acceleratore AI di Nvidia disponibile sul mercato, Google ha scelto una strada differente. La sua infrastruttura AI cloud si basa prevalentemente sulla propria linea di Tensor Processing Units (TPU) personalizzate. Dopo aver annunciato la settima generazione di TPU, denominata Ironwood, nel 2025, l'azienda ha ora presentato la sua ottava generazione. Non si tratta però di una semplice iterazione più veloce del chip precedente, ma di un'evoluzione mirata.

Questa strategia sottolinea l'impegno di Google nello sviluppo di silicio proprietario, un fattore che le consente un controllo più profondo sull'ottimizzazione dell'hardware per i propri carichi di lavoro specifici. La capacità di progettare chip su misura offre vantaggi significativi in termini di efficienza energetica e prestazioni, aspetti cruciali per la gestione di infrastrutture AI su larga scala.

TPU 8t e TPU 8i: Specializzazione per l'Era degli Agenti

Le nuove TPU di ottava generazione si presentano in due varianti distinte, fornendo a Google e ai suoi clienti una piattaforma AI che l'azienda descrive come più veloce ed efficiente. Google promuove l'idea che l'"era degli agenti" rappresenti un cambiamento fondamentale rispetto ai sistemi AI precedenti, rendendo necessario un nuovo approccio all'hardware. Per questo motivo, gli ingegneri hanno concepito la TPU 8t, ottimizzata per il training, e la TPU 8i, dedicata all'inference.

La TPU 8t è stata progettata specificamente per la fase di addestramento dei modelli AI, con l'obiettivo di ridurre i tempi necessari per i modelli AI più avanzati da mesi a settimane. Questo è un aspetto critico, poiché l'addestramento di Large Language Models (LLM) e altri modelli di frontiera richiede risorse computazionali immense e tempi prolungati. La specializzazione dell'hardware per il training permette di accelerare l'iterazione e lo sviluppo di nuovi modelli. D'altra parte, la TPU 8i si concentra sull'inference, ovvero l'esecuzione dei modelli addestrati per generare risposte o analizzare dati, dove la bassa latenza e l'alto throughput sono prioritari.

Implicazioni per l'Framework e il TCO

Sebbene le TPU di Google siano primariamente destinate all'infrastruttura cloud dell'azienda, i principi che guidano la loro progettazione hanno risonanze significative anche per chi valuta deployment on-premise. La distinzione tra hardware ottimizzato per il training e hardware per l'inference è fondamentale per qualsiasi strategia infrastrutturale AI. Le esigenze di VRAM, larghezza di banda della memoria e potenza di calcolo differiscono notevolmente tra le due fasi, influenzando direttamente il Total Cost of Ownership (TCO) e l'efficienza operativa.

Per le organizzazioni che considerano soluzioni self-hosted, la scelta di acceleratori specifici per il training o per l'inference può determinare la scalabilità, i costi energetici e la capacità di gestire carichi di lavoro diversificati. L'ottimizzazione hardware, come quella perseguita da Google con le sue TPU, è un fattore chiave per massimizzare il ritorno sull'investimento e garantire la sovranità dei dati, soprattutto in contesti air-gapped o con stringenti requisiti di compliance. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off e supportare le decisioni di deployment.

Prospettive future nell'Era degli Agenti AI

L'introduzione di queste nuove TPU segna un passo importante nell'evoluzione dell'hardware AI, in particolare per l'emergente "era degli agenti". In questo paradigma, i sistemi AI non si limitano a rispondere a singole query, ma agiscono autonomamente, pianificando e eseguendo sequenze di azioni per raggiungere obiettivi complessi. Questo richiede non solo modelli più potenti, ma anche un'infrastruttura hardware capace di supportare cicli di elaborazione più dinamici e interattivi.

L'investimento continuo di Google in silicio personalizzato, come dimostrato dalle TPU di ottava generazione, riflette una visione a lungo termine in cui l'hardware è co-progettato con il software per sbloccare nuove capacità dell'intelligenza artificiale. Questa tendenza alla specializzazione hardware è destinata a proseguire, offrendo nuove opportunità e sfide per CTO e architetti di infrastruttura che devono bilanciare prestazioni, costi e controllo nei loro deployment AI.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!