L'Emergenza dei Colli di Bottiglia della Memoria nell'Framework AI

L'espansione esponenziale dei carichi di lavoro legati all'intelligenza artificiale, in particolare l'inference di Large Language Models (LLM), sta mettendo sotto pressione le infrastrutture dei data center. Un'osservazione chiave da parte di un Senior Vice President di Micron sottolinea come i colli di bottiglia della memoria stiano emergendo come una minaccia significativa all'efficienza delle GPU in questi ambienti. Questa problematica non è nuova, ma la sua rilevanza cresce proporzionalmente alla complessità e alla dimensione dei modelli AI.

La capacità e la larghezza di banda della memoria delle GPU sono diventate fattori determinanti per le performance. Mentre la potenza di calcolo dei processori grafici continua a evolvere rapidamente, la velocità con cui i dati possono essere trasferiti da e verso la memoria può limitare il throughput complessivo, impedendo alle unità di elaborazione di operare alla loro piena capacità. Questo scenario ha implicazioni dirette per le aziende che cercano di scalare le proprie capacità AI, sia in cloud che in ambienti self-hosted.

Il Ruolo Critico della VRAM nell'Inference di LLM

Per i Large Language Models, la VRAM (Video RAM) delle GPU non è solo una risorsa, ma un vincolo fondamentale. Modelli come Llama 3 o Mixtral possono richiedere decine o centinaia di gigabyte di memoria per essere caricati e operare efficacemente, specialmente quando si gestiscono finestre di contesto ampie o batch di inference elevati. La capacità di una singola GPU di ospitare un modello intero o una sua porzione significativa determina la necessità di tecniche come il tensor parallelism o il pipeline parallelism, che a loro volta introducono overhead di comunicazione.

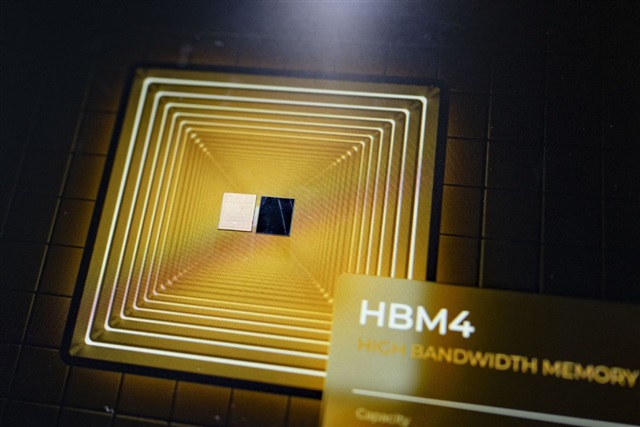

Oltre alla capacità, la larghezza di banda della memoria è cruciale. L'inference di LLM è spesso "memory-bound", il che significa che la velocità con cui i token vengono generati dipende più dalla rapidità di accesso ai pesi del modello e agli embeddings che dalla pura potenza di calcolo. GPU con memoria HBM (High Bandwidth Memory) offrono un vantaggio significativo in questo contesto, ma il loro costo e la loro disponibilità possono rappresentare una barriera per molti deployment on-premise.

Implicazioni per i Deployment On-Premise e il TCO

Per CTO, DevOps lead e architetti di infrastruttura che valutano soluzioni self-hosted per carichi di lavoro AI, i colli di bottiglia della memoria hanno un impatto diretto sul Total Cost of Ownership (TCO). Investire in GPU con maggiore VRAM e larghezza di banda può comportare un CapEx iniziale più elevato, ma può ridurre l'OpEx a lungo termine grazie a una maggiore efficienza, un minor numero di server necessari e un consumo energetico ottimizzato per un dato throughput. La scelta tra GPU con 40GB, 80GB o più di VRAM diventa una decisione strategica che bilancia performance, costi e scalabilità.

La sovranità dei dati e le esigenze di compliance spesso spingono le organizzazioni verso deployment on-premise o air-gapped. In questi scenari, la gestione efficiente delle risorse hardware, inclusa la memoria GPU, è fondamentale per garantire che i modelli AI possano operare in modo performante e sicuro all'interno dell'infrastruttura locale. Per chi valuta deployment on-premise, esistono trade-off complessi tra costi iniziali, performance e scalabilità. AI-RADAR offre framework analitici su /llm-onpremise per supportare queste valutazioni, fornendo strumenti per analizzare i vincoli e le opportunità di diverse configurazioni.

Prospettive Future e Strategie di Mitigazione

Affrontare i colli di bottiglia della memoria richiede un approccio multifattoriale. Sul fronte hardware, l'innovazione continua nelle tecnicie di memoria e nelle architetture di interconnessione (come NVLink o CXL) mira a superare questi limiti. Sul fronte software, tecniche come la quantization (ad esempio, da FP16 a INT8 o INT4) e la potatura dei modelli (pruning) possono ridurre significativamente l'ingombro della memoria e i requisiti di larghezza di banda, pur mantenendo un livello accettabile di accuratezza.

Gli sviluppatori di framework e gli ingegneri di machine learning sono costantemente alla ricerca di algoritmi più efficienti per la gestione della memoria e l'ottimizzazione dell'inference. La capacità di un'organizzazione di implementare queste strategie, combinata con una pianificazione infrastrutturale oculata, sarà cruciale per sbloccare il pieno potenziale dell'AI su larga scala, garantendo che l'efficienza delle GPU non sia compromessa dai limiti della memoria.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!