Dietro le Quinte di Task Manager: La Verità sull'Utilizzo della CPU

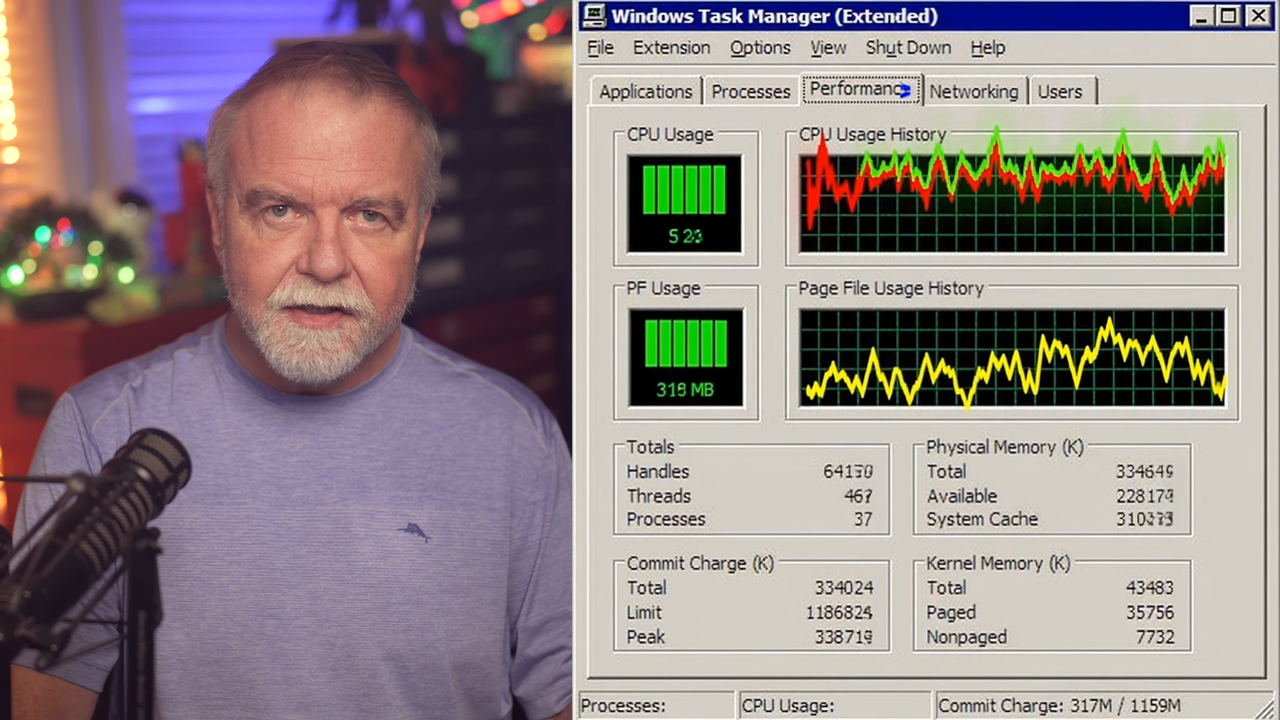

Il Task Manager di Windows è uno degli strumenti più familiari per milioni di utenti e professionisti IT, un punto di riferimento per monitorare le prestazioni del sistema e gestire i processi. Tuttavia, la sua rappresentazione dell'utilizzo della CPU ha spesso generato interrogativi e persino frustrazione. Dave Plummer, l'ingegnere di Microsoft che ha concepito e sviluppato la versione originale di Task Manager, ha recentemente offerto una spiegazione dettagliata sul perché la metrica di utilizzo della CPU possa talvolta sembrare "ingannevole" o non corrispondere alle aspettative dell'utente. La sua analisi illumina la complessità intrinseca di un compito che, a prima vista, appare banale.

Plummer ha evidenziato come la misurazione dell'attività del processore non sia una semplice lettura diretta, ma piuttosto il risultato di un'interpretazione sofisticata dei cicli di clock e degli stati del processore. Questa rivelazione offre una prospettiva cruciale per chiunque si occupi di gestione dell'infrastruttura, sottolineando l'importanza di comprendere le metodologie sottostanti agli strumenti di monitoraggio.

La Complessità Nascosta della Misurazione CPU

Misurare l'utilizzo della CPU in un sistema operativo moderno è un esercizio di equilibrio tra precisione e leggibilità. Le CPU contemporanee non sono semplici unità di calcolo monolitiche; sono architetture complesse con più core, thread logici (come l'Hyper-Threading di Intel), diverse modalità operative (user mode, kernel mode) e stati di risparmio energetico. Un singolo valore percentuale di "utilizzo CPU" deve sintetizzare tutte queste dinamiche.

La sfida principale risiede nel distinguere tra il tempo in cui la CPU è attivamente impegnata in calcoli utili e il tempo in cui è in attesa di dati o istruzioni, o semplicemente in stato di idle. Gli algoritmi di Task Manager, come spiegato da Plummer, devono campionare costantemente l'attività del processore, calcolando la percentuale di tempo in cui i core sono stati attivi rispetto al tempo totale. Questa campionatura può portare a fluttuazioni rapide e a valori che non sempre riflettono la percezione umana di "carico", specialmente con carichi di lavoro a burst o processi che alternano rapidamente stati attivi e inattivi.

Implicazioni per i Carichi di Lavoro AI e i Deployment On-Premise

Per i professionisti che gestiscono infrastrutture complesse, in particolare quelle dedicate a carichi di lavoro di intelligenza artificiale e Large Language Models, una comprensione approfondita delle metriche di sistema è fondamentale. Anche se l'inference e il training degli LLM sono spesso accelerati da GPU ad alte prestazioni, la CPU gioca ancora un ruolo critico nella pipeline complessiva. Gestisce il pre-processing dei dati, l'orchestrazione dei container, la gestione della memoria e la comunicazione tra i vari componenti hardware.

Un'interpretazione errata dell'utilizzo della CPU può portare a decisioni subottimali nel deployment on-premise. Ad esempio, un valore di utilizzo della CPU apparentemente basso potrebbe mascherare colli di bottiglia dovuti a latenza I/O o a inefficienze nel sistema operativo, mentre un picco improvviso potrebbe essere un evento transitorio e non un indicatore di sovraccarico costante. Per chi valuta deployment self-hosted, comprendere queste sfumature è essenziale per ottimizzare il TCO, garantire la sovranità dei dati e massimizzare il throughput senza investimenti eccessivi in hardware non necessario. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off in modo strutturato.

Trasparenza e Ottimizzazione dell'Framework

La spiegazione di Dave Plummer non è solo un aneddoto storico, ma un promemoria della complessità intrinseca che si cela dietro le interfacce utente apparentemente semplici. Per CTO, DevOps lead e architetti di infrastruttura, questo sottolinea l'importanza di andare oltre le metriche superficiali e di approfondire il funzionamento degli strumenti di monitoraggio.

La capacità di interpretare correttamente i dati di utilizzo della CPU, considerando le metodologie di campionamento e le architetture hardware sottostanti, è cruciale per la pianificazione della capacità, la risoluzione dei problemi e l'ottimizzazione delle risorse. In un'era in cui i carichi di lavoro AI richiedono prestazioni estreme e un controllo granulare sull'hardware, una comprensione chiara di come i sistemi operativi misurano e riportano l'attività del processore diventa un asset strategico per garantire l'efficienza e l'affidabilità delle infrastrutture self-hosted.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!