L'eredità di un pioniere del linguaggio naturale

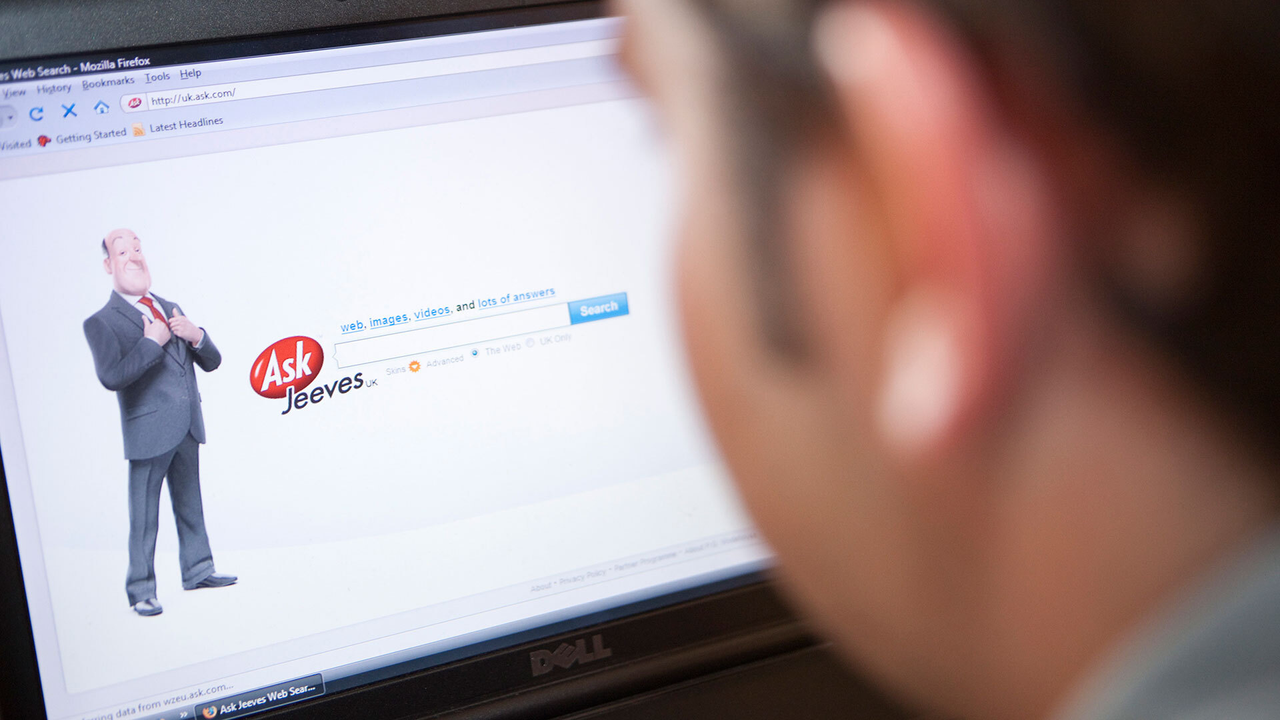

Il panorama digitale saluta un pezzo della sua storia: Ask Jeeves, il motore di ricerca che ha segnato gli anni '90, ha ufficialmente cessato le operazioni, lasciando dietro di sé solo una pagina placeholder. Noto per la sua interfaccia che permetteva agli utenti di formulare domande in linguaggio naturale, Ask Jeeves ha rappresentato un tentativo precoce e significativo di rendere l'interazione con i sistemi di ricerca più intuitiva e umana. Sebbene la sua tecnicia fosse basata su regole e pattern predefiniti, la visione di un assistente digitale capace di comprendere il linguaggio umano ha anticipato di decenni le capacità che oggi associamo ai moderni Large Language Models (LLM).

La chiusura del sito da parte della sua società madre non è solo la fine di un brand, ma anche un momento per riflettere su quanto sia progredita la capacità delle macchine di elaborare e rispondere al linguaggio umano. Dalle prime e rudimentali implementazioni di Ask Jeeves, il settore ha compiuto passi da gigante, spinto da decenni di ricerca in linguistica computazionale e intelligenza artificiale.

Dall'elaborazione simbolica ai Large Language Models

L'approccio di Ask Jeeves all'elaborazione del linguaggio naturale era prevalentemente simbolico, basato su grammatiche e ontologie per interpretare le domande degli utenti. Questo metodo, pur innovativo per l'epoca, presentava limiti intrinseci in termini di scalabilità e flessibilità, richiedendo un'intensa manutenzione manuale per adattarsi a nuove espressioni o domini. L'evoluzione ha poi visto l'emergere di modelli statistici e, più recentemente, delle architetture Transformer che sono alla base degli attuali LLM.

Questi modelli moderni, addestrati su quantità massive di dati testuali, non si limitano a riconoscere pattern, ma apprendono rappresentazioni complesse del linguaggio, permettendo una comprensione e generazione di testo molto più sofisticata. La loro capacità di svolgere compiti come la sintesi, la traduzione, la classificazione e la risposta a domande in modo contestualmente rilevante ha ridefinito le aspettative sull'interazione uomo-macchina. Tuttavia, la potenza di questi LLM porta con sé nuove sfide, specialmente per le aziende che considerano un deployment on-premise.

Le sfide del deployment on-premise per gli LLM

Per CTO, DevOps lead e architetti infrastrutturali, la gestione e il deployment di LLM in ambienti self-hosted o air-gapped presenta una serie di considerazioni critiche. A differenza dei sistemi più semplici del passato, gli LLM richiedono risorse computazionali significative, in particolare per l'inference. La scelta dell'hardware, come le GPU con specifiche VRAM elevate (es. A100 80GB o H100 SXM5), diventa fondamentale per garantire throughput adeguati e latenze accettabili. La quantization dei modelli e l'ottimizzazione dei Framework di serving sono passaggi essenziali per massimizzare l'efficienza e ridurre il consumo di risorse.

Il Total Cost of Ownership (TCO) è un fattore determinante. Sebbene il cloud offra flessibilità, il deployment on-premise può presentare vantaggi economici a lungo termine, oltre a garantire una maggiore sovranità dei dati e compliance normativa, aspetti cruciali per settori regolamentati come quello finanziario o sanitario. La costruzione di una pipeline di deployment robusta, che includa strategie per il fine-tuning e l'aggiornamento dei modelli, è un investimento infrastrutturale che richiede un'attenta pianificazione. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra costi, performance e controllo.

Il futuro del linguaggio naturale e il controllo infrastrutturale

L'addio di Ask Jeeves ci ricorda il lungo percorso compiuto dall'intelligenza artificiale nel campo del linguaggio naturale. Da un pioniere che cercava di interpretare le nostre domande con regole fisse, siamo arrivati a sistemi che generano testi complessi e rispondono a quesiti con una fluidità sorprendente. Questa evoluzione non è solo tecnicica, ma anche strategica, specialmente per le aziende che desiderano mantenere il controllo sui propri dati e sulle proprie infrastrutture.

La decisione di adottare un approccio self-hosted per gli LLM non è banale e implica una profonda comprensione delle specifiche hardware, delle esigenze di sicurezza e delle implicazioni di TCO. Mentre il ricordo di Ask Jeeves svanisce, l'impegno verso soluzioni di intelligenza artificiale sempre più potenti e controllabili rimane una priorità per chi opera nel cuore dell'infrastruttura tecnicica moderna.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!