L'AI nei browser: un nuovo paradigma di interazione

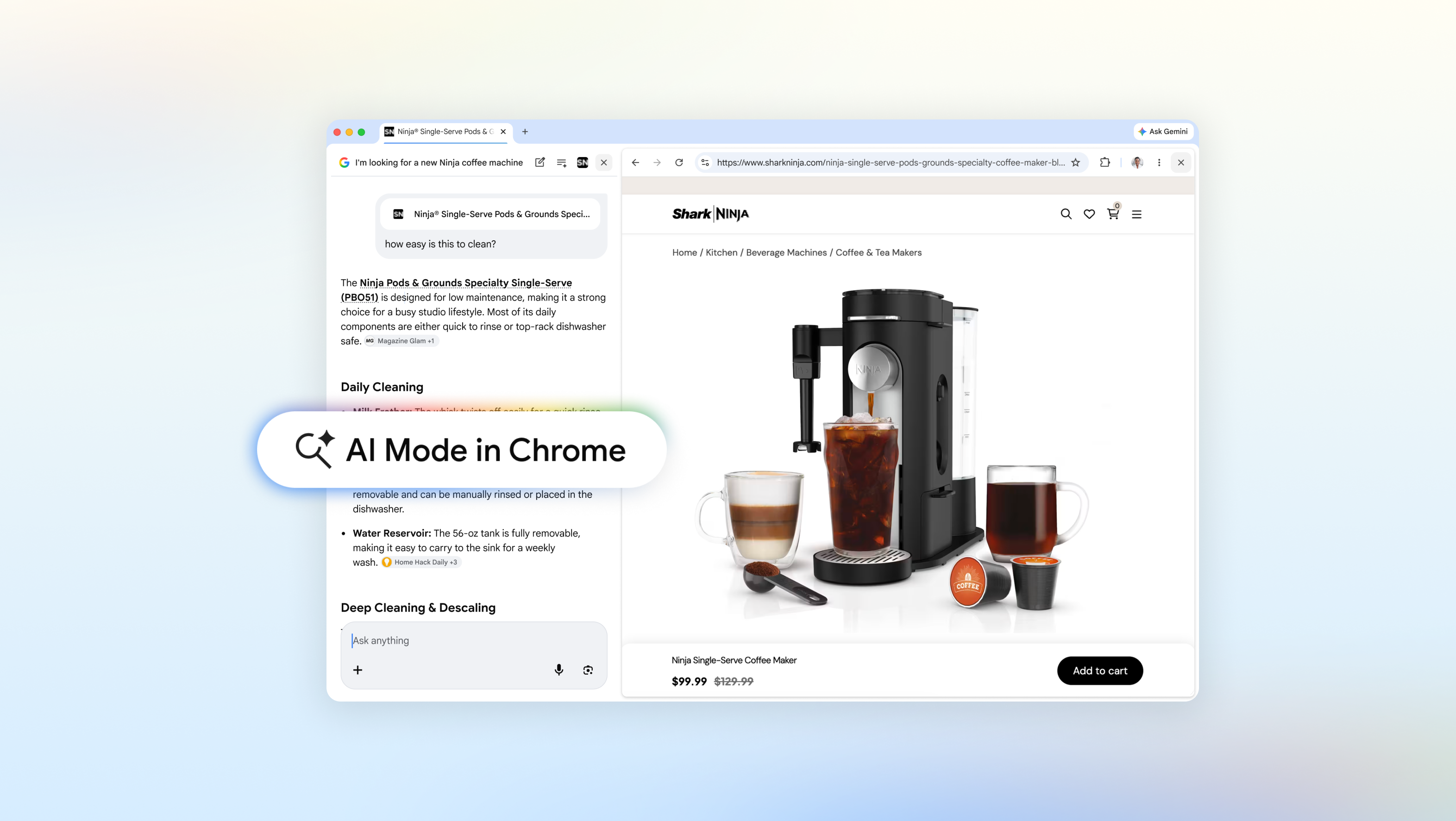

Le recenti evoluzioni nel panorama dei browser web, esemplificate dagli aggiornamenti alla "AI Mode" di Chrome, stanno ridefinendo le modalità di interazione degli utenti con i contenuti online. Questa integrazione di capacità basate su Large Language Models (LLM) promette di trasformare l'esperienza di navigazione, offrendo nuove possibilità di esplorazione e interazione. Tuttavia, dietro queste innovazioni user-facing, si celano complesse decisioni architetturali e infrastrutturali che meritano un'analisi approfondita.

Per le aziende e i professionisti IT, l'adozione di funzionalità AI nei prodotti consumer solleva interrogativi fondamentali. La questione centrale riguarda il luogo fisico e logico in cui avviene l'elaborazione dei dati e l'esecuzione dei modelli. Si tratta di un'inference eseguita interamente nel cloud, sul dispositivo client (edge computing), o in un modello ibrido? La risposta ha implicazioni dirette su aspetti come la sovranità dei dati, la latenza e il Total Cost of Ownership (TCO).

Dettagli tecnici e architetturali per l'inference LLM

L'implementazione di funzionalità AI avanzate, in particolare quelle che sfruttano LLM, richiede risorse computazionali significative. Tradizionalmente, l'inference di LLM di grandi dimensioni è stata relegata a infrastrutture cloud scalabili, dotate di GPU ad alte prestazioni come le NVIDIA A100 o H100, con VRAM elevata per ospitare i modelli e garantire throughput adeguato. Questo approccio offre scalabilità e riduce il carico sui dispositivi client, ma comporta dipendenza da terze parti e potenziali preoccupazioni per la privacy dei dati.

Un'alternativa, sempre più rilevante per scenari specifici, è l'esecuzione dell'inference AI direttamente sul dispositivo o in ambienti self-hosted. Questo richiede modelli più compatti, spesso ottenuti tramite tecniche di quantization, e hardware client con capacità di calcolo sufficienti. Sebbene l'esecuzione on-premise o all'edge possa migliorare la latenza e rafforzare la sovranità dei dati, presenta sfide in termini di gestione, aggiornamento dei modelli e requisiti hardware minimi. Per le aziende che considerano l'integrazione di LLM in applicazioni interne o prodotti con requisiti stringenti di compliance, la valutazione di deployment on-premise è cruciale.

Implicazioni per la sovranità dei dati e il TCO

La scelta tra un'architettura basata su cloud e una on-premise o ibrida ha un impatto diretto sulla sovranità dei dati. Quando l'elaborazione avviene su server esterni, i dati degli utenti potrebbero essere soggetti a giurisdizioni diverse e a politiche di privacy che non sempre si allineano con le esigenze aziendali o le normative locali, come il GDPR. Per settori altamente regolamentati, la capacità di mantenere i dati all'interno dei propri confini infrastrutturali, magari in ambienti air-gapped, diventa un requisito non negoziabile.

Inoltre, il Total Cost of Ownership (TCO) è un fattore determinante. Sebbene il cloud offra un modello OpEx flessibile, i costi possono aumentare rapidamente con l'incremento dell'utilizzo e della complessità dei modelli. Un deployment on-premise, pur richiedendo un investimento iniziale (CapEx) più elevato per l'acquisto di hardware (GPU, server, storage), può offrire costi operativi prevedibili e potenzialmente inferiori nel lungo termine, specialmente per carichi di lavoro stabili e ad alto volume. La valutazione di questi trade-off è fondamentale per i CTO e gli architetti di infrastruttura.

Prospettive future e decisioni strategiche

L'evoluzione dell'AI nei browser è solo un esempio di come i Large Language Models stiano permeando ogni aspetto dell'interazione digitale. Per le organizzazioni, la capacità di comprendere e gestire le implicazioni di queste tecnicie è strategica. La decisione su dove e come deployare le capacità AI — che sia per un'applicazione interna, un servizio rivolto al cliente o l'ottimizzazione di processi — richiede un'analisi approfondita dei requisiti di performance, sicurezza, compliance e TCO.

AI-RADAR si concentra proprio su questi aspetti, fornendo framework analitici per valutare i trade-off tra soluzioni self-hosted e cloud per carichi di lavoro LLM. La chiave è scegliere l'architettura che meglio si allinea con gli obiettivi aziendali, garantendo al contempo controllo, efficienza e conformità normativa.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!