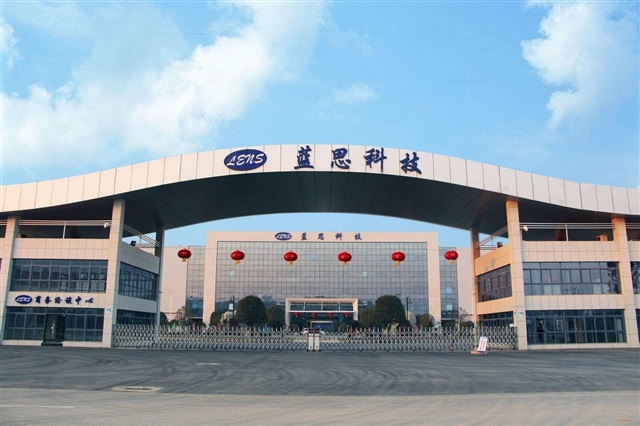

Le sfide della catena di fornitura globale: il caso Lens Technology

La notizia della flessione nei risultati finanziari di Lens Technology, un fornitore chiave per Apple, ha riacceso i riflettori sulle vulnerabilità e le tensioni che attraversano le catene di fornitura globali nel settore tecnicico. Questo "earnings shock" non è un evento isolato, ma piuttosto un sintomo delle complessità e delle interdipendenze che caratterizzano la produzione di dispositivi e componenti ad alta tecnicia. La performance di un singolo attore può avere ripercussioni significative sull'intera pipeline produttiva di giganti come Apple, evidenziando la necessità di strategie di mitigazione del rischio sempre più robuste.

Il settore tecnicico, e in particolare quello che alimenta l'innovazione negli LLM e nell'intelligenza artificiale, dipende in modo critico dalla disponibilità di hardware specifico. Componenti come GPU ad alte prestazioni con ampie quantità di VRAM, moduli di memoria avanzati e processori specializzati sono il cuore pulsante delle infrastrutture AI. Le interruzioni nella catena di fornitura possono quindi tradursi in ritardi nella produzione, aumento dei costi e difficoltà nel soddisfare la domanda, influenzando direttamente la capacità delle aziende di innovare e scalare le proprie soluzioni.

L'impatto sui deployment di LLM on-premise

Per le organizzazioni che valutano il deployment di Large Language Models on-premise, le dinamiche della catena di fornitura assumono un'importanza strategica. La decisione di ospitare infrastrutture AI localmente è spesso guidata da esigenze di sovranità dei dati, compliance normativa o dalla volontà di mantenere un controllo totale sull'ambiente operativo, inclusi gli ambienti air-gapped. Tuttavia, questa scelta comporta una maggiore dipendenza dall'approvvigionamento diretto di hardware. La disponibilità di server, GPU (come le A100 o H100 con specifiche VRAM elevate) e soluzioni di storage ad alta velocità diventa un fattore limitante o abilitante.

Le fluttuazioni nei prezzi e nei tempi di consegna dei componenti possono alterare drasticamente il Total Cost of Ownership (TCO) di un'infrastruttura on-premise. Un ritardo nella consegna di un lotto di GPU può posticipare l'intero progetto di mesi, con costi operativi e opportunità mancate. Per chi valuta deployment on-premise, è fondamentale considerare non solo il costo iniziale (CapEx) ma anche la resilienza della catena di fornitura come parte integrante dell'analisi del TCO. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off, fornendo strumenti per una pianificazione strategica informata.

Strategie per mitigare i rischi e garantire la resilienza

Di fronte a un panorama di catene di fornitura sempre più volatili, le aziende devono adottare strategie proattive per mitigare i rischi. La diversificazione dei fornitori è una tattica comune, che riduce la dipendenza da un singolo attore e aumenta la flessibilità in caso di interruzioni. Anche la creazione di scorte di sicurezza (buffer stock) per i componenti critici può offrire un cuscinetto contro ritardi imprevisti, sebbene ciò comporti costi aggiuntivi di stoccaggio e gestione del capitale.

Un'altra strategia emergente è la localizzazione o regionalizzazione della produzione e dell'approvvigionamento. Sebbene non sempre fattibile per tutti i componenti ad alta tecnicia, ridurre la distanza geografica tra produttore e consumatore può diminuire i tempi di consegna e la vulnerabilità a eventi geopolitici o disastri naturali. Per le infrastrutture AI, in particolare quelle destinate a carichi di lavoro sensibili o critici, la capacità di garantire un flusso costante di hardware affidabile è tanto importante quanto la scelta del modello LLM o del framework di deployment.

Prospettive future per l'infrastruttura AI

Il caso di Lens Technology serve da monito per l'intero ecosistema tecnicico. La resilienza della catena di fornitura non è più solo una questione logistica, ma un pilastro strategico che influenza la capacità di innovazione e la competitività. Per le aziende che investono in Large Language Models e intelligenza artificiale, la pianificazione dell'infrastruttura deve estendersi oltre le specifiche tecniche dei server e delle GPU, abbracciando una visione olistica che includa la robustezza dell'approvvigionamento.

Garantire l'accesso a hardware performante e affidabile è essenziale per sostenere l'evoluzione dei modelli e l'efficienza dell'inference. Che si tratti di deployment on-premise, ibridi o edge, la capacità di anticipare e gestire le sfide della catena di fornitura sarà un fattore determinante per il successo a lungo termine delle strategie AI. Le decisioni odierne in merito all'approvvigionamento e alla gestione dei fornitori plasmeranno la capacità di deployment e la scalabilità delle soluzioni AI di domani.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!