L'evoluzione del packaging CoWoS di TSMC

TSMC, leader mondiale nella produzione di semiconduttori, ha recentemente delineato la roadmap per la sua tecnicia di packaging avanzato CoWoS (Chip-on-Wafer-on-Substrate). Questa innovazione è fondamentale per l'industria dei chip ad alte prestazioni, in particolare per i processori destinati ai carichi di lavoro di intelligenza artificiale. L'annuncio evidenzia un percorso di sviluppo ambizioso, con previsioni di significative evoluzioni entro il 2029.

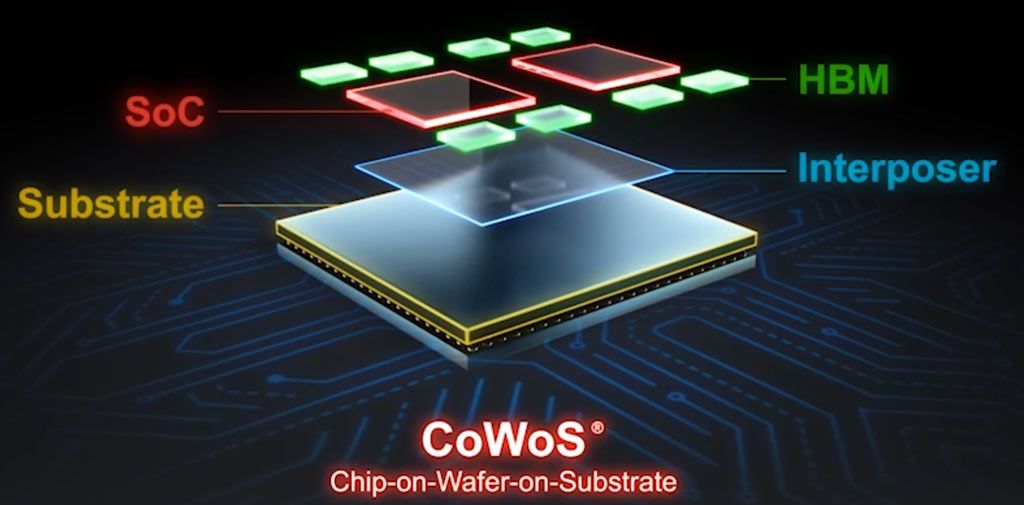

Il packaging CoWoS è una tecnicia cruciale che permette di integrare più chip, come GPU e memoria HBM (High Bandwidth Memory), su un unico substrato, riducendo le distanze di interconnessione e massimizzando l'efficienza. Questa integrazione è vitale per superare i limiti fisici dei chip monolitici e per soddisfare la crescente domanda di potenza di calcolo e larghezza di banda della memoria richiesta dai Large Language Models (LLM) e da altre applicazioni AI intensive.

Dettagli tecnici: potenza e memoria per l'AI

La roadmap di TSMC prevede l'introduzione di pacchetti che supereranno i 14 reticoli. Un reticolo è un'unità di misura standard nell'industria dei semiconduttori, e un aumento di questa dimensione indica una capacità di integrazione notevolmente superiore, permettendo di ospitare un numero maggiore di componenti o componenti più grandi all'interno dello stesso package. Questa espansione dimensionale è direttamente correlata alla capacità di elaborazione complessiva.

Le proiezioni indicano un balzo di 48 volte nella potenza di calcolo, un incremento che potrebbe ridefinire le capacità dei futuri acceleratori AI. Tale aumento sarà supportato dalla possibilità di integrare fino a 24 stack HBM5E. La memoria HBM è essenziale per i carichi di lavoro AI, offrendo una larghezza di banda molto superiore rispetto alle memorie tradizionali. L'adozione di 24 stack HBM5E, una versione avanzata della tecnicia HBM, garantirà un ulteriore significativo incremento della larghezza di banda della memoria, elemento critico per alimentare LLM sempre più grandi e complessi che richiedono accesso rapido a enormi quantità di dati.

Implicazioni per i deployment on-premise

Questi progressi nel packaging hanno profonde implicazioni per le organizzazioni che valutano deployment AI on-premise o self-hosted. La maggiore densità di calcolo e la larghezza di banda della memoria offerte dai futuri pacchetti CoWoS consentiranno di costruire infrastrutture AI locali più potenti ed efficienti. Per CTO, DevOps lead e architetti infrastrutturali, ciò significa la possibilità di gestire carichi di lavoro AI complessi, inclusi training e inference di LLM di grandi dimensioni, direttamente nei propri data center.

La capacità di integrare più potenza di calcolo e memoria in un singolo package è fondamentale per ottimizzare il TCO (Total Cost of Ownership) delle infrastrutture on-premise. Una maggiore densità riduce l'ingombro fisico, i requisiti di alimentazione e raffreddamento per unità di calcolo, e potenzialmente i costi operativi a lungo termine. Inoltre, per le aziende con stringenti requisiti di sovranità dei dati, compliance o la necessità di ambienti air-gapped, l'hardware avanzato che abilita performance elevate on-premise è una componente strategica irrinunciabile. Per chi valuta deployment on-premise, esistono framework analitici su /llm-onpremise per valutare i trade-off tra soluzioni self-hosted e cloud.

Prospettive future e trade-off

L'evoluzione della tecnicia CoWoS di TSMC sottolinea la direzione in cui si sta muovendo l'industria dei semiconduttori per supportare la crescita esponenziale dell'AI. La capacità di integrare un numero sempre maggiore di transistor e moduli di memoria in un unico package è la chiave per sbloccare nuove frontiere nella potenza di calcolo.

Tuttavia, queste innovazioni comportano anche dei trade-off. La complessità di produzione e i costi associati al packaging avanzato possono aumentare. Inoltre, la gestione termica di pacchetti così densi e potenti richiederà soluzioni di raffreddamento sempre più sofisticate all'interno dei data center. Le aziende dovranno bilanciare le esigenze di performance con le considerazioni di costo, efficienza energetica e complessità operativa, scegliendo le architetture che meglio si adattano ai loro specifici vincoli e obiettivi strategici.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!